Últimamente me he estado fijando en que el calibrado de imágenes en PixInsight produce un efecto raro al trabajar con imágenes capturadas con un CCD en color RGB (p. ej. con cámaras DSLR). El caso es que después de aplicar los darks y flats utilizando la herramienta Image Calibration de PixInsight se obtiene una imagen en la que el canal rojo está mucho más exagerado que los otros dos.

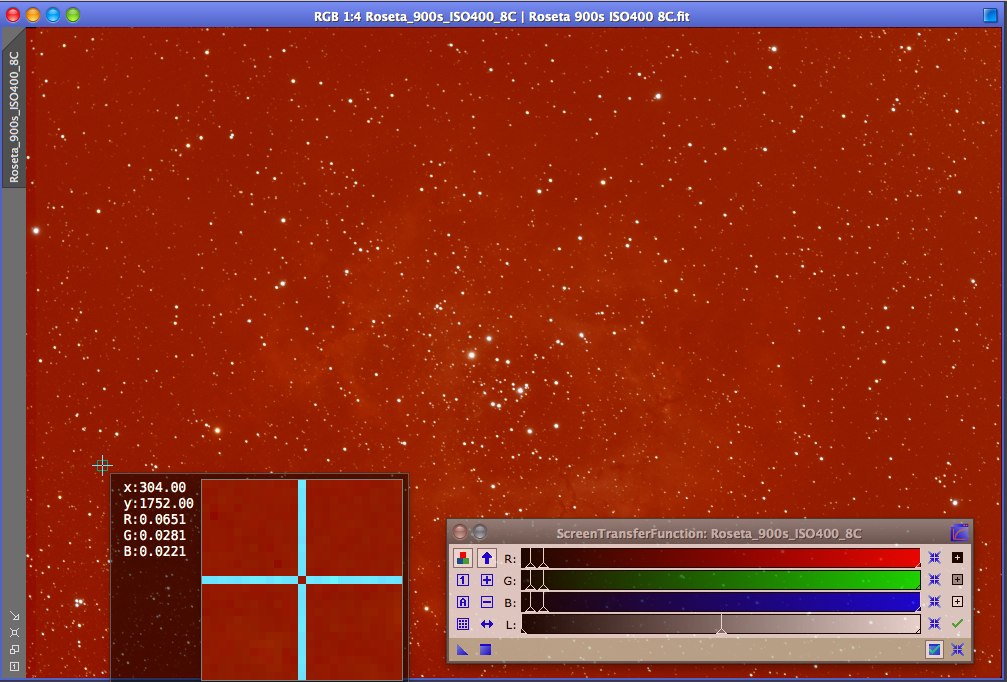

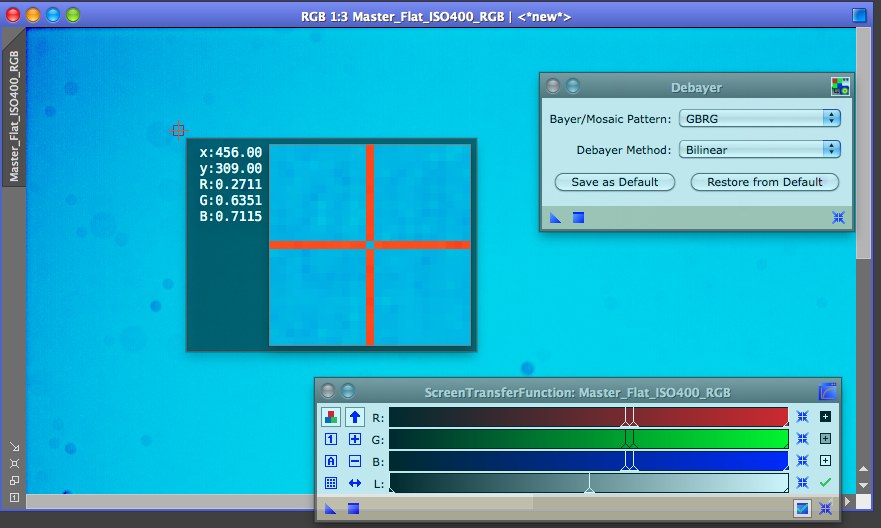

En la siguiente imagen se puede ver un ejemplo de lo que comento:

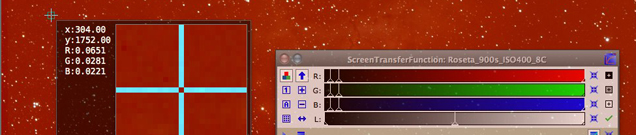

En la imagen anterior queda claro que el canal rojo tiene un valor que casi triplica el de los canales azul y verde. Esto resulta especialmente extraño si observamos una del las capturas originales antes de hacer el calibrado:

Aquí los valores de los canales RGB aparecen mucho más equilibrados, y en cualquier caso el canal rojo no es ni mucho menos mayor que los valores de los otros dos canales. Entonces… ¿por qué después del calibrado se ha producido una distorsión en el equilibrio de los canales?

Recordemos que el proceso de las imágenes capturadas antes de hacer el apilado consiste en:

- Restar el Dark para eliminar el ruido propio de la cámara

- Dividir por el Flat para eliminar los efectos de viñeteo y otros defectos del tren óptico (manchas, polvo, etc…)

- Debayerizar para convertir la imagen a color RGB

Es importante notar que los dos primeros pasos se realizan sobre la imagen RAW, es decir, tal y como la ha capturado el sensor. De hecho, en PixInsight los dos primeros pasos se realizan simultáneamente mediante la herramienta «Image Calibration», donde indicamos tanto el Dark como el Flat que queremos utilizar.

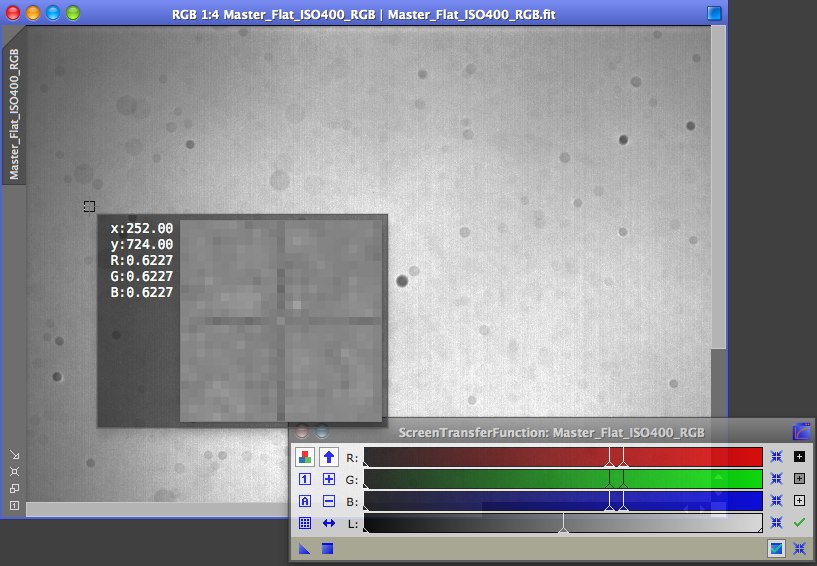

El problema está en la aplicación del Flat. Nosotros normalmente capturamos los flats mediante la técnica de la «camiseta blanca», es decir, poniendo una tela blanca sobre la abertura del telescopio y apuntando a una zona despejada del cielo. Pero el cielo es azul. Normalmente no debayerizamos el frame correspondiente al Flat, ya que lo habitual es aplicarlo sobre la imagen RAW. Pero si lo hacemos obtendremos lo siguiente:

Al ver esto empieza a quedar claro cual es el problema: el canal rojo es mucho menor que el verde y el azul. Y como la aplicación del flat implica hacer una división del fotograma por el flat, el resultado obvio es que los pixeles correspondientes a los sensores rojos del CCD serán amplificados de manera importante respecto a los otros dos sensores (el canal rojo se divide por valores del orden de 0,2 mientras que los otros dos se dividen por 0,6 o 0,7)

De aquí se desprende que no parece muy buena idea aplicar el flat de esta manera.

Nosotros proponemos un método alternativo que nos ha funcionado estupendamente, y para llevarlo a cabo lo primero que hay que hacer es construir un Flat en el que los 3 canales sean iguales. Esto lo podemos hacer de la siguiente manera:

- Extraer el canal de luminancia: con esto obtenemos una imagen con un único plano de color (niveles de gris)

- Convertir la imagen a color RGB: esto hace que se triplique el plano con los niveles de gris en tres planos idénticos para los canales R, G y B

Tras efectuar estos pasos obtenemos lo siguiente:

Pero claro, ahora tenemos un Flat en RGB que no se puede aplicar sobre las imágenes si no se debayerizan previamente. Por este motivo el procedimiento de calibrado que proponemos es el siguiente:

- Aplicar el Dark en primer lugar para eliminar el ruido introducido por la cámara

- Debayerizar la imagen para convertirla a color RGB

- Aplicar el Flat en grises que hemos obtenido según las indicaciones anteriores

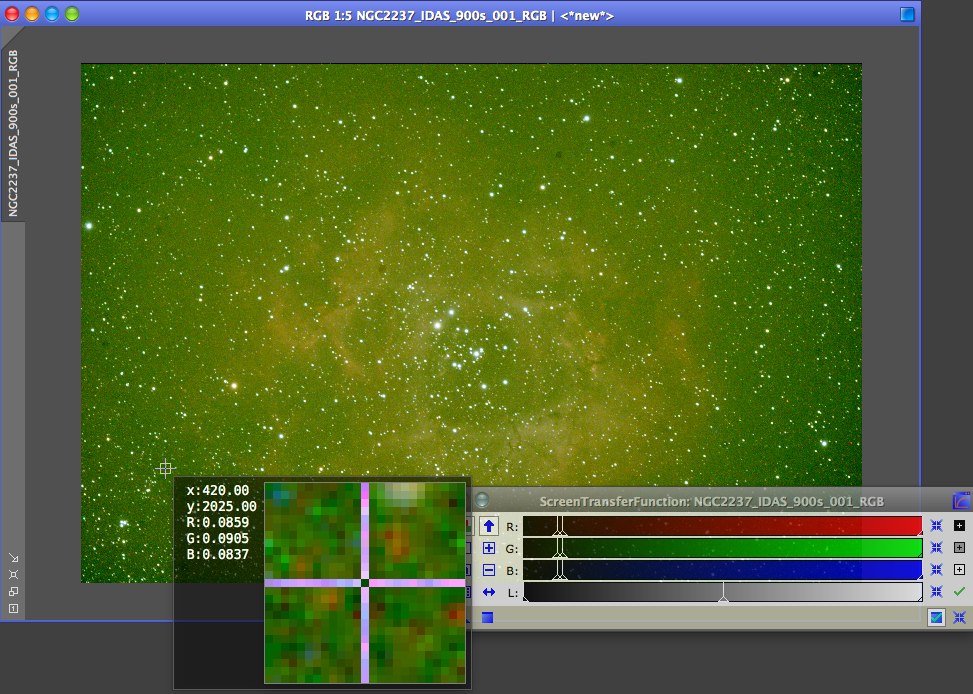

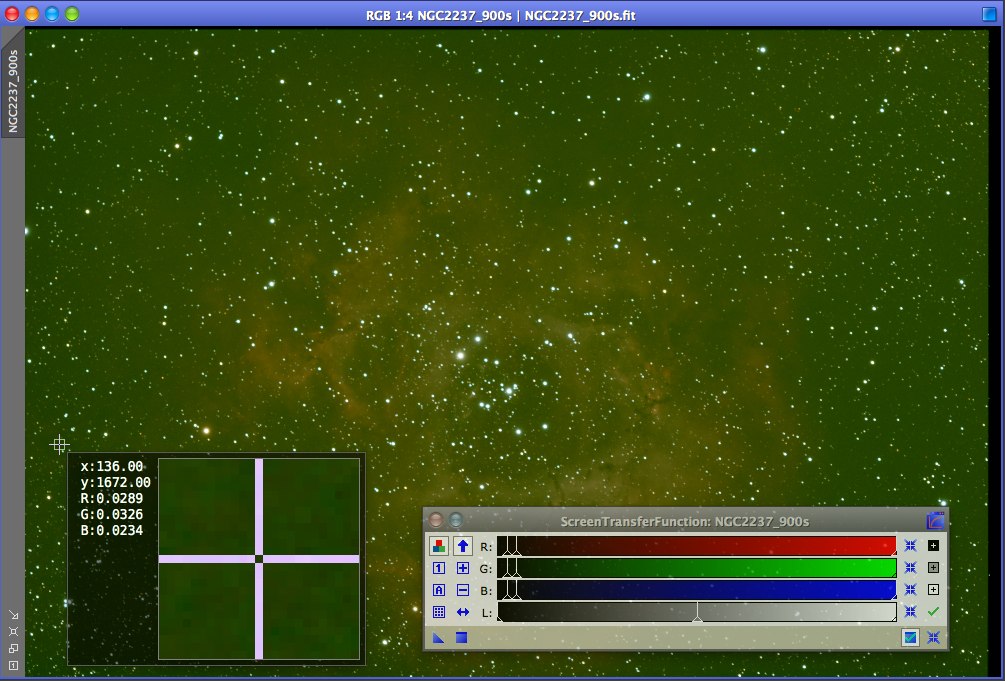

Y de esta manera ya se obtiene un resultado mucho más razonable que concuerda perfectamente con las tomas originales (sin procesado):

Observaciones importantes

Podría pensarse que no es necesario hacer todo esto ya que aunque mediante el calibrado tradicional se acentúe el canal rojo, posteriormente podemos ajustar el balance de blancos para que todo quede correcto.

Sin embargo esto no es cierto, y resulta especialmente evidente en los «donuts» o manchas de las ópticas. La división es una operación no lineal, y si dividimos los píxels correspondientes a los sensores rojos por valores diferentes a los verdes y azules, como resultado obtendremos que al debayerizar la imagen la luminancia en esos puntos no será correcta y al final del calibrado no habremos eliminado por completo las imperfecciones, sino que quedarán cercos.

Por otra parte, la aplicación de flats se realiza para compensar las diferencias de iluminación sobre el sensor debidas a las obstrucciones propias del telescopio y otros factores como manchas o polvo. Parece lógico pensar que estas diferencias de iluminación afectarán de la misma manera a todos los sensores de una misma zona, y por tanto hay que considerar que la atenuación producida en todos los sensores, sean azules, rojos o verdes debería ser igual.